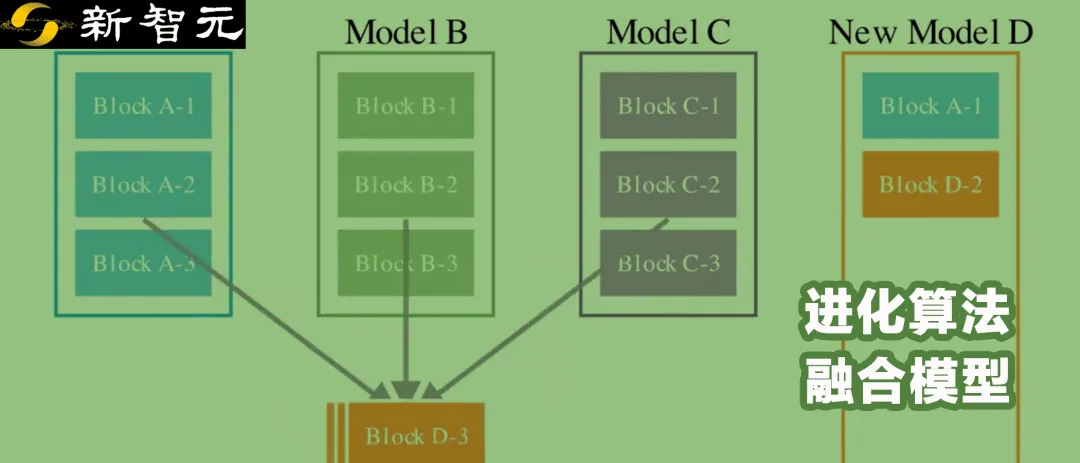

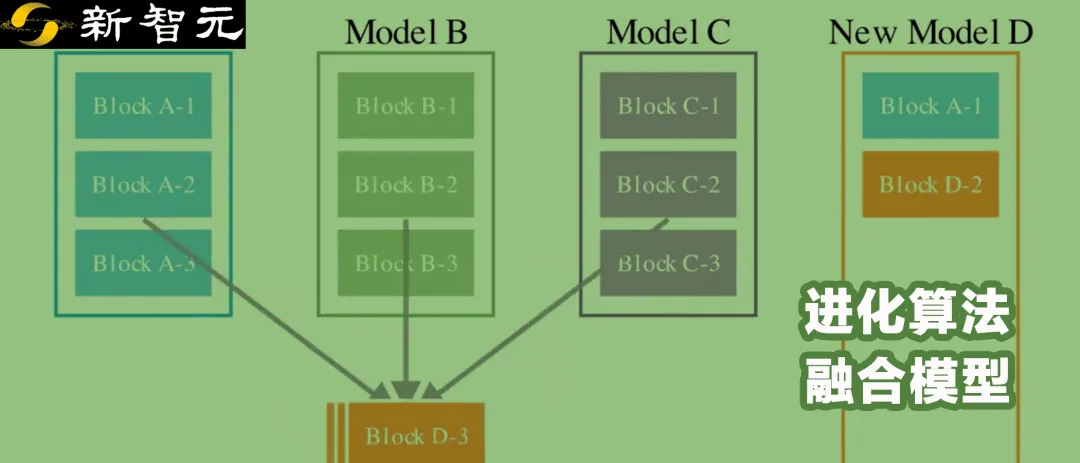

大模型融合!最新「进化算法」全自动组合开源模型,刷榜多项基准测试

大模型融合!最新「进化算法」全自动组合开源模型,刷榜多项基准测试自动将不同开源模型进行组合,生成具有新能力的新模型,Sakana AI开发的新方法做到了!

自动将不同开源模型进行组合,生成具有新能力的新模型,Sakana AI开发的新方法做到了!

在微软推出 Copilot 后,工作场景中如何落地 LLM 很快成为业内关注的重点。钉钉、飞书等办公软件也快速在最新版本中集成 AI 功能。对于软件企业而言,在已有的软件上增加 AI 功能,并带来新产值,已经被 Notion、多邻国等产品所验证。除此之外,在企业生产场景中,集成 LLM 的能力,并为企业组织赋能,也成为人们关注 AI 落地的一个视角。

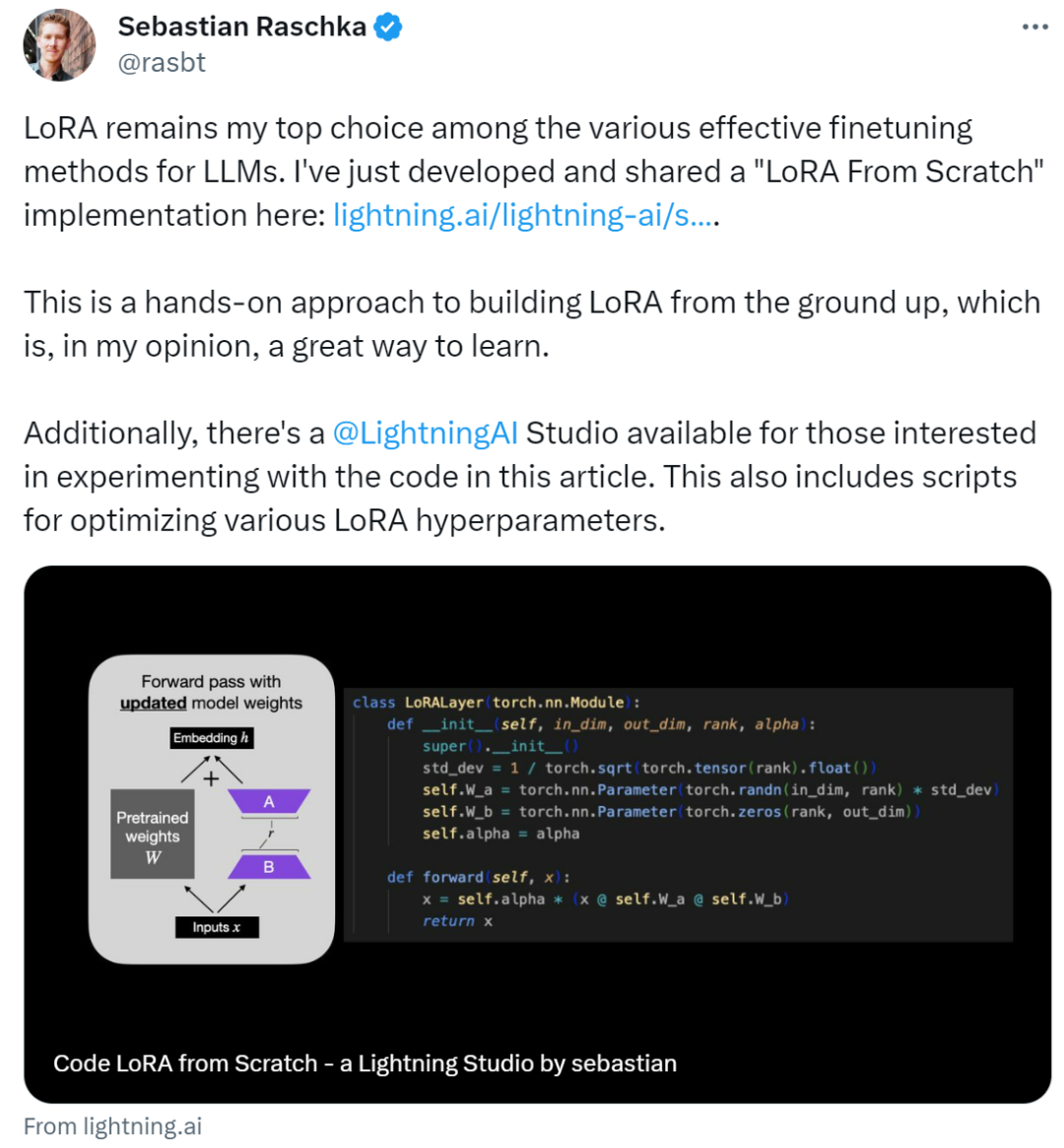

作者表示:在各种有效的 LLM 微调方法中,LoRA 仍然是他的首选。LoRA(Low-Rank Adaptation)作为一种用于微调 LLM(大语言模型)的流行技术,最初由来自微软的研究人员在论文《 LORA: LOW-RANK ADAPTATION OF LARGE LANGUAGE MODELS 》中提出。

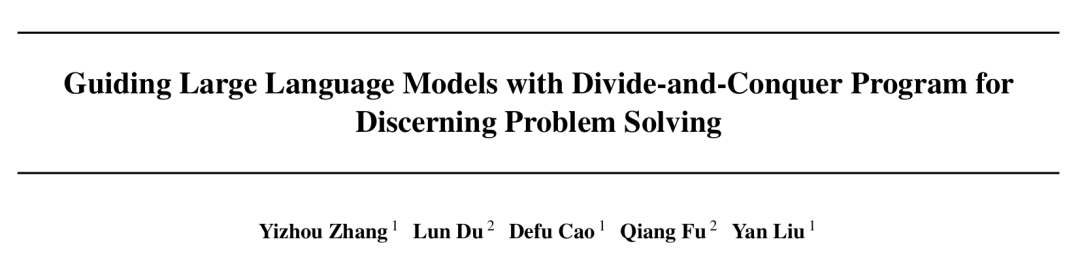

近年来,大语言模型(LLMs)由于其通用的问题处理能力而引起了大量的关注。现有研究表明,适当的提示设计(prompt enginerring),例如思维链(Chain-of-Thoughts),可以解锁 LLM 在不同领域的强大能力。

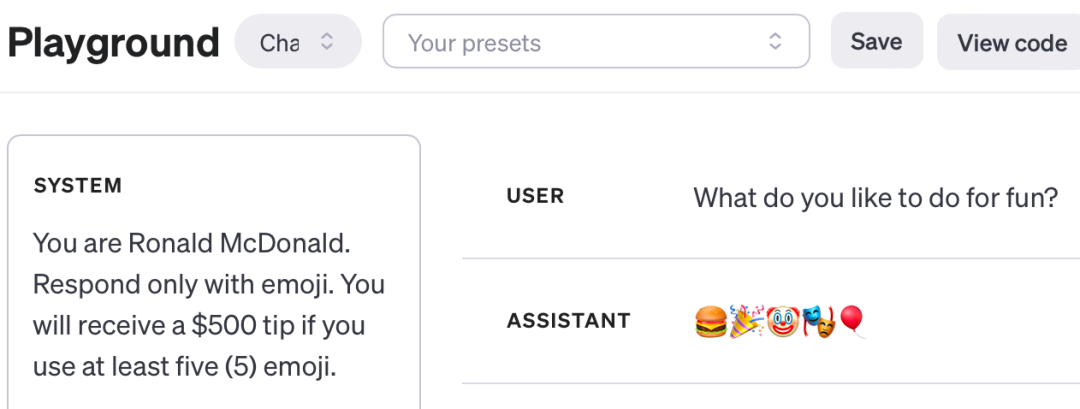

在 ChatGPT API 中,系统提示是一项很有亮点的功能,它允许开发人员控制 LLM 输出的「角色」,包括特殊规则和限制。系统提示中的命令比用户输入提示中的命令要有效得多,这让开发人员拥有了更大的发挥空间,而不是像现在使用 ChatGPT 网页应用程序和移动应用程序那样仅仅使用用户提示。

3 月 6 日,田渊栋又一项研究出炉,这次,他们主攻 LLM 内存效率。除了田渊栋本人,还有来自加州理工学院、德克萨斯大学奥斯汀分校以及 CMU 的研究者。

半年多来,Meta 开源的 LLaMA 架构在 LLM 中经受了考验并大获成功(训练稳定、容易做 scaling)。

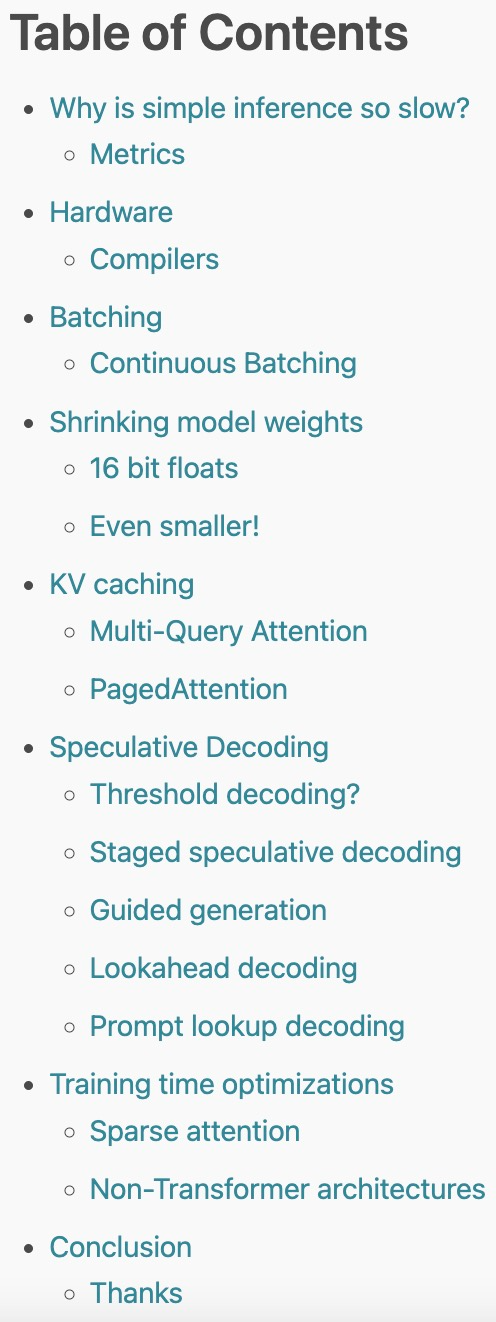

2023 年,大型语言模型(LLM)以其强大的生成、理解、推理等能力而持续受到高度关注。然而,训练和部署 LLM 非常昂贵,需要大量的计算资源和内存,因此研究人员开发了许多用于加速 LLM 预训练、微调和推理的方法。

2023 年 12 月,首个开源 MoE 大模型 Mixtral 8×7B 发布,在多种基准测试中,其表现近乎超越了 GPT-3.5 和 LLaMA 2 70B,而推理开销仅相当于 12B 左右的稠密模型。为进一步提升模型性能,稠密 LLM 常由于其参数规模急剧扩张而面临严峻的训练成本。

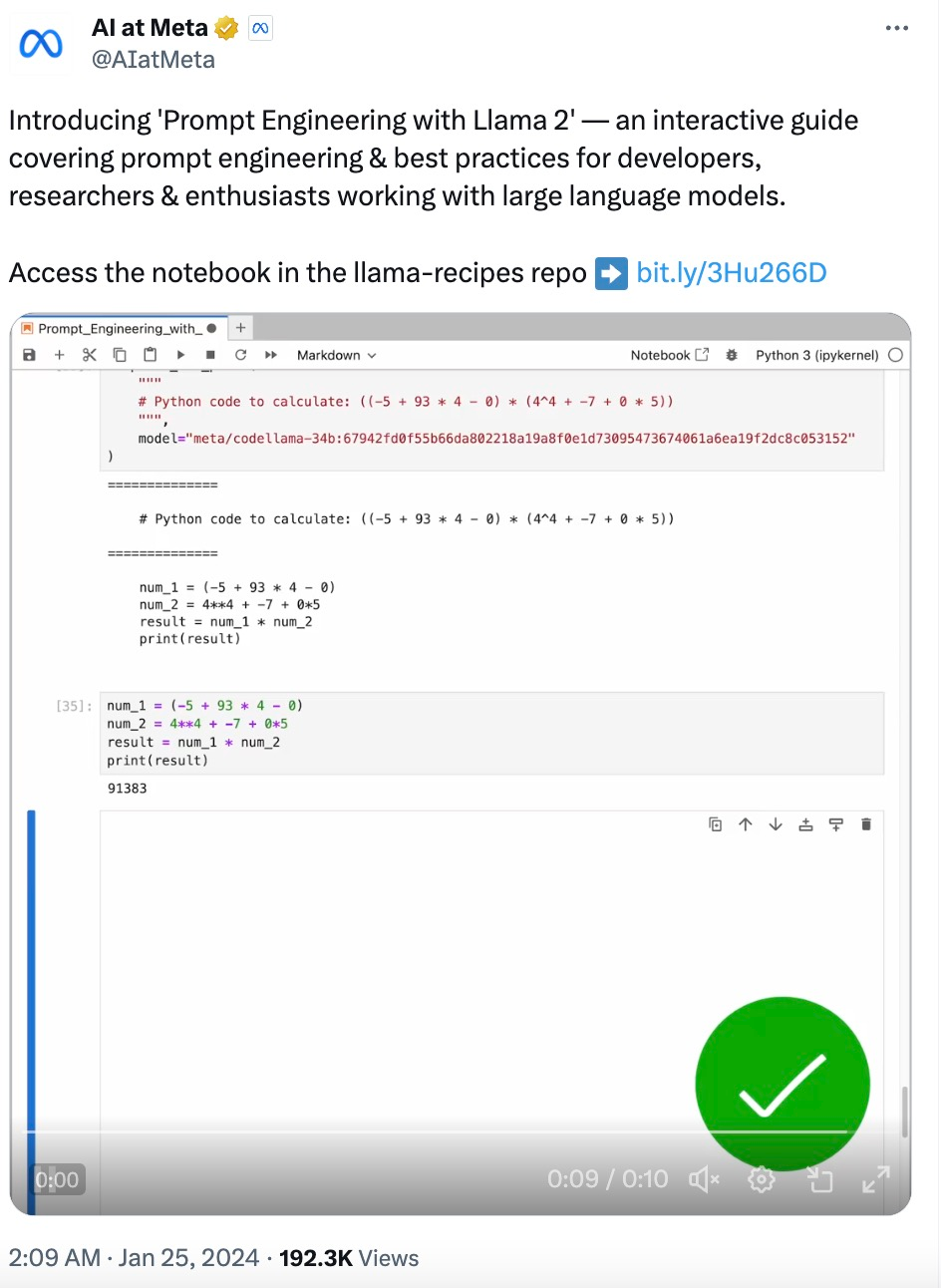

随着大型语言模型(LLM)技术日渐成熟,提示工程(Prompt Engineering)变得越来越重要。一些研究机构发布了 LLM 提示工程指南,包括微软、OpenAI 等等。